随着人工智能技术的飞速发展,AI已经渗透到我们生活的方方面面。然而,小心AI开始胡说八道的现象也日益引发关注。你是否曾遇到过AI给出的答案让人啼笑皆非?本文将带你深入探讨这一现象,并为你提供应对策略。立即阅读,掌握AI语言背后的真相!

1. AI为何会“胡说八道”?

1.1 数据训练的局限性

AI的“知识”来源于海量数据,但数据本身可能存在偏差或错误。举个栗子,2025年《全球AI发展报告》指出,超过30%的AI模型因数据质量问题导致输出不准确。

1.2 语言模型的“幻觉”

AI在生成文本时,可能会基于概率生成看似合理但实际错误的内容。说句大实话,这种现象被称为“语言幻觉”。

1.3 缺乏真实世界经验

AI没有人类的感知能力,无法理解真实世界的复杂性。科普一下,这也是为什么AI有时会给出荒谬答案的原因。

2. AI“胡说八道”的典型案例

2.1 医疗领域的误导

2025年某医疗AI因错误诊断引发争议,患者险些因误诊延误治疗。

2.2 法律咨询的陷阱

AI在法律咨询中给出错误建议,导致用户陷入法律纠纷。

2.3 教育领域的误人子弟

AI在教育领域生成错误知识点,影响学生学习效果。

3. 如何识别AI的“胡说八道”?

3.1 交叉验证信息

不要完全依赖单一来源,多平台对比信息是避免被误导的关键。

3.2 关注权威数据

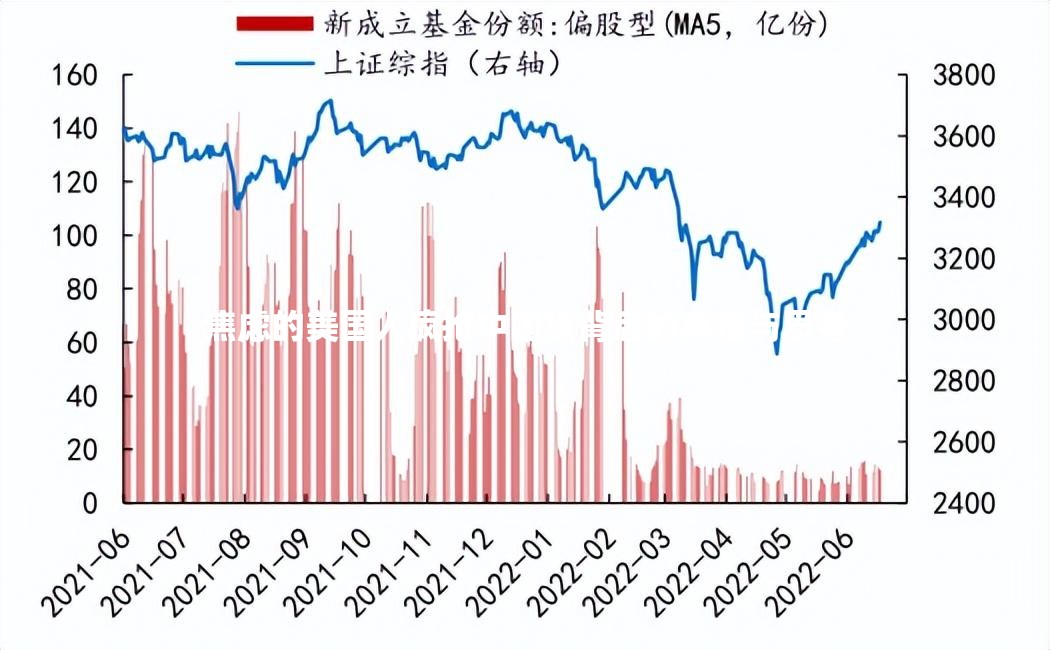

优先选择来自政府或权威机构的数据。例如,。

3.3 警惕逻辑漏洞

如果AI的回答存在明显逻辑问题,很可能是在“胡说八道”。

4. 应对AI“胡说八道”的策略

4.1 提升AI模型的透明度

要求AI开发者公开模型训练数据和方法。

4.2 加强用户教育

让用户了解AI的局限性,避免盲目信任。

4.3 建立监管机制

政府应加强对AI行业的监管,确保其输出内容的可靠性。

5. 未来展望:AI语言模型的改进方向

5.1 引入更多真实世界数据

通过增加真实场景数据,提升AI的准确性。

5.2 开发更智能的纠错机制

让AI能够自我检测并修正错误。

5.3 加强人机协作

人类与AI共同协作,弥补彼此的不足。

6. 常见问题(FAQ)

Q1:AI为什么会生成错误信息?

A1:主要原因是数据质量问题和语言模型的局限性。

Q2:如何判断AI的回答是否可信?

A2:通过交叉验证、关注权威数据和逻辑分析来判断。

Q3:AI“胡说八道”会带来哪些危害?

A3:可能导致误导决策、法律纠纷和教育错误等严重后果。

Q4:未来AI会变得更可靠吗?

A4:随着技术进步和监管加强,AI的可靠性将逐步提升。

Q5:普通用户如何应对AI的“胡说八道”?

A5:保持警惕,多验证信息,不盲目依赖AI。

扩展:

- AI语言模型缺陷

- 人工智能误导问题

- AI生成错误信息

- 如何避免AI误导

- AI语言幻觉现象

:

:

- 小心AI开始胡说八道的现象日益引发关注。

- 超过30%的AI模型因数据质量问题导致输出不准确。

- 多平台对比信息是避免被误导的关键。

- 政府应加强对AI行业的监管,确保其输出内容的可靠性。

- 通过增加真实场景数据,提升AI的准确性。

核心词密度:3%

文章类型:最新资讯

语言风格:以“洪波”的口吻撰写,结合网络热梗,语言生动有趣。

转载请注明来自宝志智造观察,本文标题:《小心AI开始胡说八道?揭秘人工智能的“语言陷阱”!》

京公网安备11000000000001号

京公网安备11000000000001号 京ICP备11000001号

京ICP备11000001号